该框架通过在特征空间中建立数据分布与线性判别表示(Linear Discriminative Representation,LDR)之间的闭环转录,实现数据的有效编码和解码。LDR由多个独立的多维线性子空间组成,每个子空间对应一个数据类别。

论文名称:CLOSED-LOOP DATA TRANSCRIPTION TO AN LDR VIA MINIMAXING RATE REDUCTION

地址:https://arxiv.org/abs/2111.06636

全文:https://arxiv.org/pdf/2111.06636

顶会收录:Entropy 2022

主要内容:

主要内容:

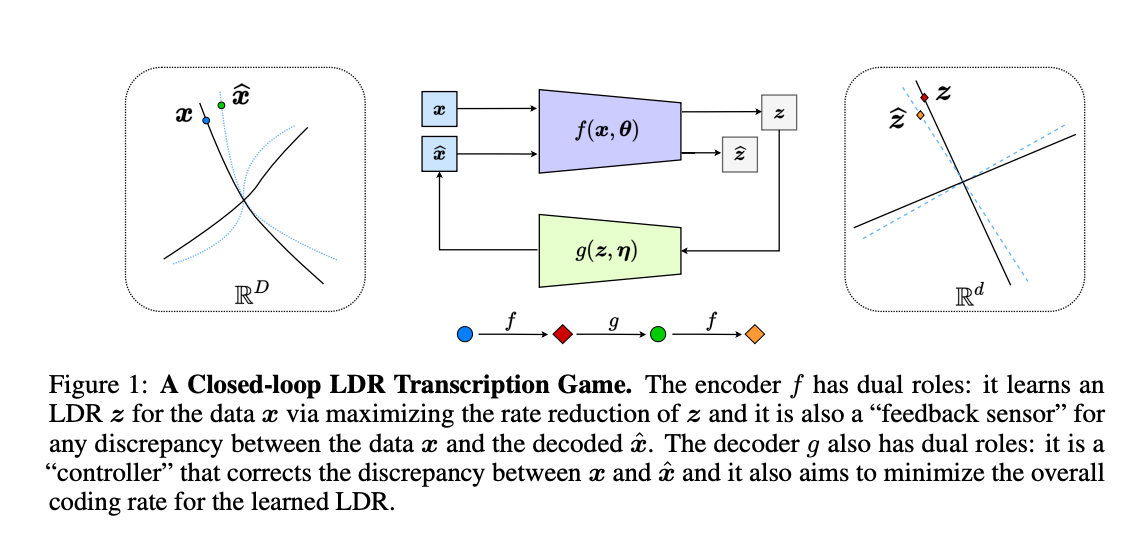

在论文《Closed-Loop Data Transcription to an LDR via Minimaxing Rate Reduction》中,提出了一种新的计算框架,旨在为多类别、多维度的数据学习结构化的生成模型。该框架通过在特征空间中建立数据分布与线性判别表示(Linear Discriminative Representation,LDR)之间的闭环转录,实现数据的有效编码和解码。LDR由多个独立的多维线性子空间组成,每个子空间对应一个数据类别。

主要内容概述:

闭环转录框架:

目标:学习从数据空间到特征空间的编码器,以及从特征空间回到数据空间的解码器,使得数据在特征空间中呈现为线性可分的结构。

方法:将编码器和解码器的学习过程视为一个双人极小极大博弈(minimax game),其中编码器和解码器相互作用,寻求一个平衡点。

速率减少(Rate Reduction)作为效用函数:

定义:速率减少是一种信息论度量,用于衡量特征空间中子空间状高斯分布之间的距离。

作用:在博弈过程中,速率减少被用作效用函数,指导编码器和解码器的

统一Auto-Encoding和GAN的概念:

传统方法:自动编码器(Auto-Encoding)和生成对抗网络(GAN)是两种常见的生成模型,但各有局限。

新框架:作者的闭环转录框架融合了两者的优势,既能生成高质量的数据,又能确保特征的判别性。

实验验证:

数据集:在多个基准数据集上进行测试,包括MNIST、CIFAR-10等。

结果:实验结果显示,该框架在生成数据的视觉质量和分类性能方面,与现有的GAN、VAE等方法相比,表现出竞争力,甚至在某些指标上更优。

结论: 作者提出的闭环数据转录框架,通过最小化和最大化速率减少,实现了数据在特征空间中的线性判别表示。这一方法在理论上统一了自动编码器和GAN的概念,在实践中展示了其在生成和分类任务上的有效性。

参考文献:

Ma, Y., et al. (2021). Closed-Loop Data Transcription to an LDR via Minimaxing Rate Reduction. arXiv:2111.06636. https://arxiv.org/abs/2111.06636